딥페이크(AI가 실제와 구별하기 어려운 가짜 사진·오디오·동영상을 생성하는 기술) 영상을 내세워 사기를 치는 사례가 급증하고 있다. 사기 행각에 유명 연예인의 딥페이크 영상을 포함하는 것은 물론 일론 머스크 테슬라 CEO(최고경영자)까지 등장했다.

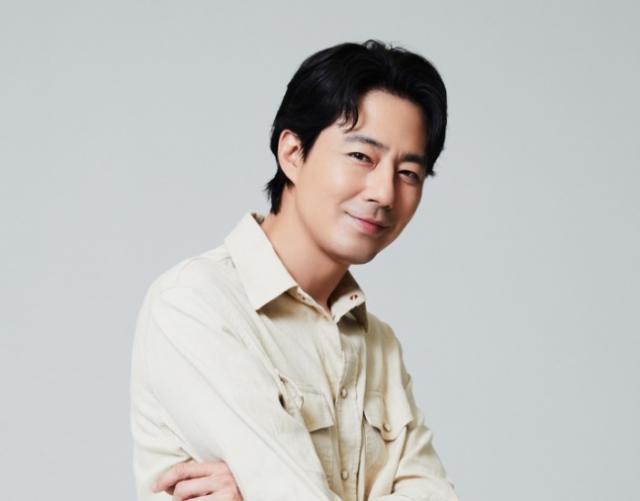

지난해 말 조인성, 송혜교 얼굴과 음성을 조작한 가짜 영상을 활용해 투자를 권유한 사기 행각이 드러났다. 영상 속에는 송혜교와 조인성이 각각 자신의 이름을 말하며 행사 개최에 감사하다고 말한다. 그러나 이 영상은 딥페이크로 만들어진 가짜 영상이자 사기로 드러났다.

이 조직은 주식 투자계 유명 인사인 '배터리 아저씨' 박순혁 작가의 비서라고 소개하며 투자자들에게 투자를 권유한 것으로 알려졌다. 경찰은 현재 이 사건을 수사 중이다.

이런 딥페이크 투자 사기는 해외에서도 기승을 부리고 있다. 세계적인 가수 테일러 스위프트는 최근 가짜 투자 광고로 곤욕을 치렀다. 자신의 팬덤인 '스위프티(Stifties)'에게 무료로 루크르제 냄비를 선물한다는 내용을 담고 있던 콘텐츠는 매달 일정 금액이 자동 결제되도록 속인 사기였다.

머스크는 X(옛 트위터)에서 한 누리꾼이 암호화폐를 홍보하는 딥페이크 영상을 올리자 자신이 직접 아니라는 댓글을 달며 대응에 나섰다.

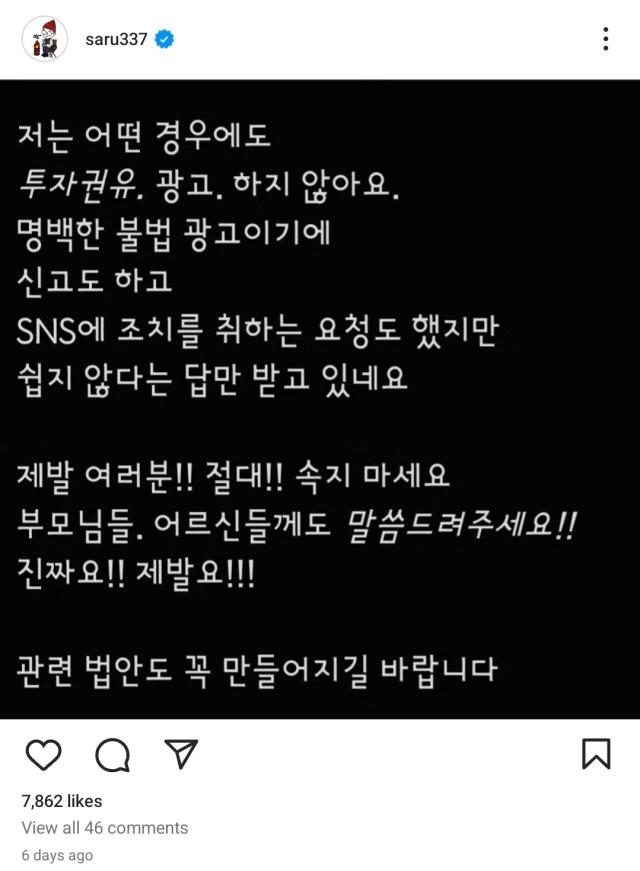

개그우먼이자 미디어랩시소 대표로 활동하는 송은이도 딥페이크 영상으로 곤혹을 치렀다. 송은이는 최근 자신의 인스타그램에 "저는 어떤 경우에도 투자 권유 광고를 하지 않는다. 명백한 불법 광고이기에 신고도 하고 SNS에 조처해 달라 요청하고 있지만 쉽지 않다는 답변을 받았다. 절대 속지 말아라"라고 당부한 바 있다.

한편 딥페이크를 활용한 투자 사기가 늘어나고는 있지만 이를 막기는 쉽지 않다는 지적이 제기된다. 관계자들은 "관련 기술이 빠르게 발전하면서 딥페이크 영상을 제작하기는 쉬워졌지만 관련 규제는 딱히 없어 소비자들이 식별하기 쉽지 않다"고 입을 모은다. 특히 유명인과 관련한 딥페이크 투자 사기의 경우 그들이 직접 나서 '내가 아니다'라고 직접 밝히는 것 외엔 현재 대안이 없는 상황이다.

©'5개국어 글로벌 경제신문' 아주경제. 무단전재·재배포 금지

![[르포] 중력 6배에 짓눌려 기절 직전…전투기 조종사 비행환경 적응훈련(영상)](https://image.ajunews.com/content/image/2024/02/29/20240229181518601151_258_161.jpg)