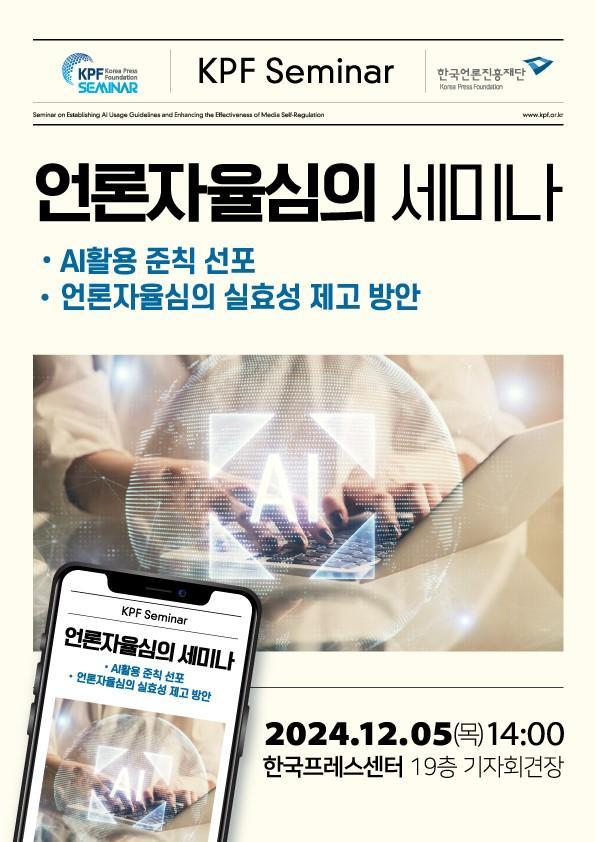

한국언론진흥재단과 6개 현업 언론인 단체는 뉴스 제작에 인공지능(AI)을 활용할 경우 철저하게 사실을 확인해야 한다는 가이드라인을 5일 제시했다.

이날 이런 내용이 담긴 '언론을 위한 생성형 인공지능 준칙'을 공표됐다. 준칙에는 AI를 뉴스 생산에 보조적 수단으로 활용해야 하며 인간의 관리 및 감독하에 사용해야 한다는 내용이 담겨있다.

특히 기술적 한계로 인해 AI가 생성한 결과물에 부정확한 사실이나 허구의 내용이 포함될 수 있으므로 이를 검증하지 않고 그대로 보도해서는 안 된다고 제언했다.

또 신뢰할 수 있는 콘텐츠를 만들기 위해 인공지능에 활용된 데이터의 사실 여부와 정확성을 점검해야 하며 기자가 확인과 검증을 할 수 없는 내용이라면 인공지능으로 생산해서는 안 된다고 권고했다.

아울러 언론사는 뉴스 생산에 인공지능을 활용하는 경우 이에 따라 발생한 문제에 대해 법률적·윤리적 책임을 져야 하며 AI 활용으로 인한 문제점을 상시 점검하고 이에 대처할 수 있는 시스템을 구축해야 한다.

AI의 활용 범위에 관해서도 가이드라인을 내놓았다. 뉴스 생산을 위한 기획과 기초 자료 조사, 아이디어 제공, 녹취 및 문자 변환, 번역, 오탈자 확인, 방대한 양의 정보 처리, 데이터 분석, 시각화 자료 생성 등 보조적 작업에서는 원칙적으로 제한 없이 AI를 활용할 수 있지만 전체 내용을 AI가 자동으로 생성한 기사와 영상은 사용하지 않는 것이 바람직하다고 재단은 설명했다.

준칙은 한국언론진흥재단과 한국신문협회·한국방송협회·한국기자협회·한국신문방송편집인협회·한국인터넷신문협회·한국온라인신문협회 등 6개 단체가 3월부터 공동 운영한 'AI시대 뉴스 저작권 포럼'을 통해 마련됐다.

©'5개국어 글로벌 경제신문' 아주경제. 무단전재·재배포 금지

![[르포] 중력 6배에 짓눌려 기절 직전…전투기 조종사 비행환경 적응훈련(영상)](https://image.ajunews.com/content/image/2024/02/29/20240229181518601151_258_161.jpg)